[충청뉴스 이성현 기자] 국내 연구진이 AI가 자신의 지식 한계를 스스로 인식하게 만드는 새로운 학습법을 개발했다.

이를 통해 자율주행이나 의료 진단처럼 안전이 직결된 분야에서 AI의 신뢰성을 획기적으로 높일 발판을 마련했다.

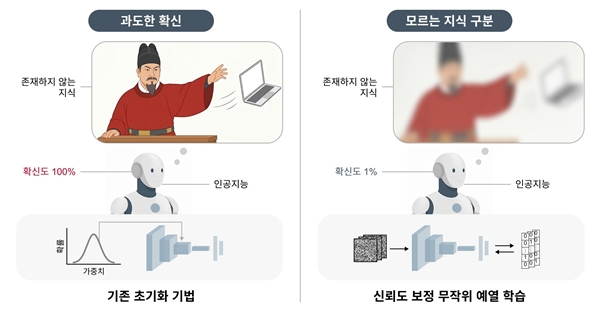

한국과학기술원(KAIST)은 뇌인지과학과 백세범 교수팀이 기존 딥러닝 모델들이 학습 시작 단계에서 가중치를 무작위로 설정하는 방식이 AI의 근거 없는 자신감을 유발하는 원인임을 밝혀냈다고 27일 밝혔다.

연구팀은 학습 전 단계에서 무의미한 데이터를 미리 학습시키는 ‘예열(warm-up)’ 전략을 대안으로 내놨다.

기존 방식은 백지 상태여야 할 초기 단계에서 이미 편향된 확신을 갖고 있어 이것이 생성형 AI의 ‘환각(Hallucination)’ 현상으로 번지기도 했다. AI가 실제 데이터를 접하기 전부터 잘못된 확신에 빠져 있었다는 분석이다.

연구팀은 그 해법으로 인간의 뇌 발달 과정에서 영감을 얻었다. 태아의 뇌가 외부 자극 없이도 스스로 신호를 만들며 회로를 다듬듯, AI에게도 본격적인 공부 전에 ‘무작위 신호’를 주는 과정을 추가했다.

이는 AI가 본격적인 학습에 들어가기 전 스스로의 불확실성을 가다듬어 '나는 아직 모른다'는 상태를 먼저 배우게 하는 과정이다.

예열을 거친 AI는 학습하지 않은 새로운 데이터를 만났을 때 억지로 답을 내놓기보다 확신도를 낮추며 ‘모른다’고 반응하는 능력이 탁월해졌다. 결과적으로 예측이 맞을 때만 높은 확신을 보이고 모를 때는 스스로 불확실함을 인지하는 ‘메타 인지’ 능력을 갖추게 된 것이다.

이는 훈련에 사용되지 않은 낯선 데이터를 걸러내는 능력으로도 이어졌다.

백세범 석좌교수는 “이번 연구는 두뇌 발달 과정을 모사함으로써 AI가 인간과 좀 더 유사하게 자신의 지식 상태를 인식할 수 있음을 보여준 사례”라며 “정확도를 높이는 것을 넘어 인공지능이 스스로의 불확실성을 판단하는 원리를 제시했다는 데 의의가 있다”고 설명했다.